はじめに

こんにちは。NTTドコモ クロステック開発部の水野涼介、中村匠です。

普段の業務では動画像認識のビジネス適用を行っています。

この記事では、2024年8月6日(火)~8月9日(金)に熊本で開催された第27回 画像の認識・理解シンポジウム(MIRU2024)の参加報告をします。特に、企業展示ブースにて塚谷・水野・春山・中村圭佑・中村匠・別宮と共にチームの取組をポスター展示させていただいた際の内容を紹介します。

斜め読みする方は途中の2枚のポスターの画像をチラ見していただければと思います。

ドコモってこんな事もやっていたんだというリアクションを貰えれば我々は満足です。

出展するにあたっての社内事情等の紹介も面白いかなと思ったのですが、本記事では触れません。

アジェンダ

1. なぜドコモがMIRU2024に企業展示を?

2. MIRUとは

3. 企業展示

- 共通事項

- スマート農業・農業AIの取組

- 自動運転遠隔監視システムの取組

4. MIRU全体トレンド

5. 気になった発表

6. 最後に

なぜドコモがMIRU2024に企業展示を?

研究者の皆さんにドコモの取組を知っていただきたい、リクルート目的、我々も勉強したい目的が主になります。

ドコモって通信以外にこんな事もやってるんですね、意外です、といった声をいただくこともあるので、ドコモのイメージをいい意味で変えていきたいという想いがあり、その活動の一環として我々のチームの取組を紹介できる場へ参加しました。特に、MIRUは我々の業務で扱っている画像認識と親和性が高く、画像の認識と理解技術に関する国内最大規模の会議です。加えて研究範囲は基礎から応用まで幅広く、議論・交流が活発に行われている場ですので、MIRU2024に出展させていただくことにしました。

MIRUとは

MIRUとは、画像の認識と理解技術に関するシンポジウムで今年度は1500名以上の方が参加されたとのことでした。

実際にオフライン会場はどの会場も常に賑わっていて、国内外の発表者や聴講者間の議論が活発に行われていました。本会議とは別にメンターシッププログラムや若手プログラム、バンケット、朝ランの会など様々なプログラムが開催されていることも特徴的です。学会運営側が研究者同士の交流の場を提供してくださっていて、研究力強化に非常に力を入れ貢献しているシンポジウムになります。

下記はそれぞれポスター会場とバンケットの写真です。ポスター会場の手前が企業ブース、奥がポスター発表ですが奥では特に多くの人が集まっており積極的に研究議論が行われていました。更にバンケット会場でも広いホール会場からあふれるほどの人が交流しており、研究力強化に非常に貢献している様子が感じれます。

企業展示

企業展示では、「スマート農業・農業AIの取組」「自動運転遠隔監視システムの取組」の2点を紹介しました。

紹介した際のポスターは下の2枚です。

共通事項

そもそもなぜ農業や自動運転をやってるの...?については真面目な理由はポスター内にあるとおりですが、メンバーが取り組みたいと言っているからというのも大きな理由のひとつです。

取り組み始めるきっかけは様々ですが、私達のチームと直接繋がりのあるお客様との対話をきっかけとして、お客様の持つ強い想いや課題感に共感したことをきっかけに始めることがあったり、私達の持っている技術をもとにお客様に提案させていただき共感してもらって始めることが多いです。

通信関係無くとも、こんなこと出来たら面白そう、こんなことやってみないかなどのご意見をお待ちしています。

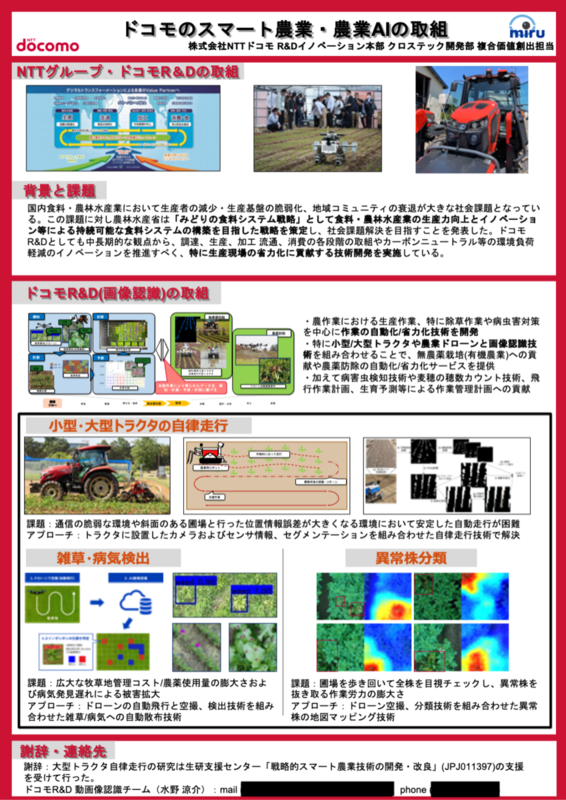

スマート農業・農業AIの取組

「スマート農業・農業AIの取組」についてです。これが一番意外と言われることが多い取組だったりしますし、家族・友人からも驚かれます。

本取り組みにおいて我々のチーム※は農業分野の社会課題を解決するためにスマート農業・農業AI技術の開発に取り組んでいます。具体的には3種類の取組みがあり、主に小型や大型のトラクターで撮影した画像をもとに自動で走行させる技術関連、ドローンで撮影した画像をもとに農作業を省力化する技術関連、その他お客様の課題毎に特化した方法で取得した画像をもとに課題解決していく3点に取り組んでいます。ポスター内ではトラクターとドローンの取組の2種類の取組を紹介しました。

※ あえてNTTドコモと言わず我々のチームと表現しています。NTTドコモの農業分野への取組となると、これ以外にも多くのことに取り組んでいますのでもっと知りたいという方はご連絡いただければと思います。

除草ロボットとトラクタに関する研究開発:除草ロボットとトラクターに関する取組

- 除草作業にかかる時間や体力の負担を軽減することを目指しています。

- カメラを機体に設置して撮影した画像を基に操舵を制御しています。撮影した画像はエッジコンピューティングで処理され、ロボットやトラクタを制御しています。

- ロボットやトラクターを動かすためのCAN通信システムをソフトウェア、ハードウェアの両方の技術、知識を活用し開発しています。

- トラクタに関しては従来の位置情報を基にした自動走行技術では課題となっていた、通信が不安定な環境や傾斜地での精度低下を解決することを目指しています。

空撮画像を活用したシステムの開発:ドローンに関する取り組み

- ドローン搭載カメラで撮影した画像を解析し、農場内の雑草や異常を検知する技術を開発しています。

- 広大な牧草地を少人数で効率的に管理するソリューションを提供しています。

- 作物の病気拡大を防ぐために、農場内を歩いて見回る労力や熟練した知識への依存を軽減する技術を目指しています。

これらの取り組みを通じて、農作業の効率化や負担軽減を図り、持続可能な農業の実現に貢献しています。

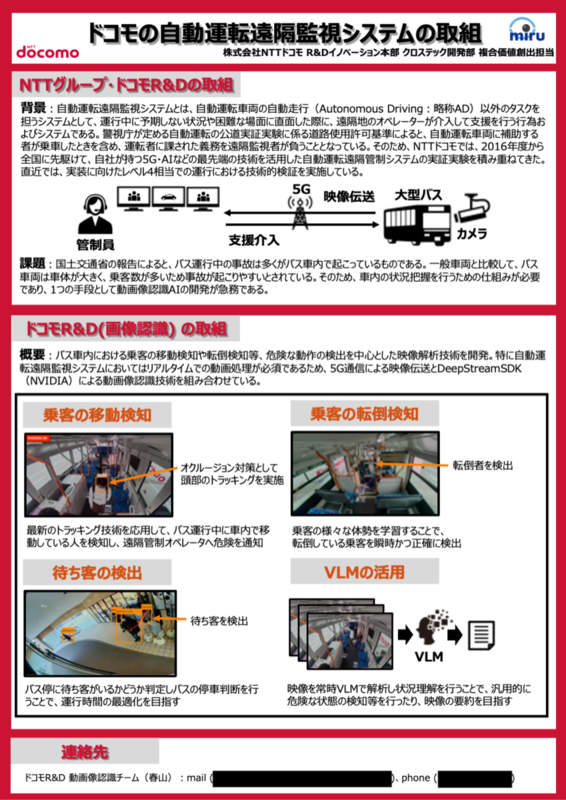

自動運転遠隔監視システムの取組

「自動運転遠隔監視システムの取組」についてです。こちらも同じく驚かれることが多いのですが、ここ数年で認知いただけている取組です。

本取り組みにおいて我々のチームは自動運転そのものの技術を開発するのではなく、自動運転の遠隔監視するオペレーターをサポートするシステムの開発に取り組んでいます。国土交通省が自動運転のレベルを5段階(レベル1~5)で表したデータのうち、レベル3以上の自動運転技術に適用する技術、特に運転手を不要とし始めるレベル4相当での自動運転技術に対する取組として実施しています。

具体的な取組紹介です。

主にバス⾞内における乗客の移動検知、転倒検知、待ち客の検出に関わる技術の開発を実施しています。特に乗客の移動検知と転倒検知ではバス⾞内での映像を伝送するとともに動画像認識技術を組み合わせた結果をオペレーターへ提⽰することで、オペレーターがいち早くバス⾞内の状況や起きている異常等に気付けるようなシステム開発に取り組んでいます。また、待ち客の検出によるバスの停⾞サポートやVision Language Model(VLM)を活⽤した取組みも実施しています。ここでは乗客の移動検知や転倒検知など、バス車内での様々な事象を理解する手助けを行い、オペレーターの業務をより幅広くサポートできるシステムの開発に取り組んでいます。

MIRU全体トレンド

まず大きなトレンドとして画像を言語情報と組み合わせて課題を解くVision&Languageの分野の研究が多く見られました。昨年からChat-GPT,Gemini,Claudeなどの大規模モデルが次々と画像入力に対応したこともあり、自然言語と画像を絡めたタスクへの関心が高まっているのを感じます。こうした大規模モデルや基盤モデルを特定タスクに落とし込んで実用していくための議論が活発に行われていました。

また、実環境での精度を向上させるドメイン適応の研究も多く見られ、基盤モデルの応用先を意識した議論が増えていると感じました。他にも、ハイパースペクトルカメラやイベントカメラなどで得られるRGB以外の画像を扱う研究も勢いのある分野のようでした。

以下では個人的に気になった発表についていくつかピックアップして紹介します!

気になった発表

大規模マルチモーダルモデルを用いた広告画像の評価・改善

砂田達巳, 塩原楓 (東大), 劉岳松, 丹治直人, 勢〆弘幸 (Septeni Japan), 肖玲, 山崎俊彦 (東大)

内容

デジタル広告の評価のためのクリック率予測に従来用いられてきたCNNなどを用いる手法は、予測を高い精度で行うことはできても説明性に乏しく、評価をうけたデザイナーが改善につなげにくいという課題があった。この研究では「余白」「統一感」...などの評価項目について自然言語でLLaVAに出力させてから特徴量空間に埋め込んで推論に使うという構成にすることで評価の観点を明確にしながらクリック率予測ができるモデルを提案した。さらにレイヤー(背景やテキストアイコンなどの広告画像の元になるパーツ)の色、サイズ、位置を少しずつ変化させた際の各評価項目に対する提案モデルの出力の変化をChat-GPTに分析させ、改善提案レポートを作成できることを示した。改善提案をもとにデザイナーが修正作業を行った広告と元の広告のどちらが優れていると感じるかをアンケートで評価したところ修正後の広告が優れているという回答が多かった。

感想

自然言語を経由することで推論結果の解釈性を高めるという利点は、他タスクでも欲しい場面が多く応用の幅が広い技術と感じました。

またその後のChat-GPTによる分析や改善提案レポートの作成など実用への議論が興味深かったです。

誤りのある順序付きラベルでの自己緩和型共同学習による重症度推定

竹崎隼平 (九大), 田中聖人 (京都第二赤十字病院), 内田誠一 (九大)

内容

内視鏡画像から潰瘍性大腸炎の重症度を推定するタスクにおいて、病気の進行は連続的であるのに対して重症度は離散的な値で付与されるラベルであるため、個人差が大きく現れてしまい正確なアノテーションが難しい。

アノテーションには医学の専門知識が必要なので、複数人がつけたラベルの平均や多数決での運用には大きなコストがかかってしまう。誤ラベルを含む学習データに対応する学習手法もあるが、それらの既存手法は順序付きラベルを想定されていない。

この研究では、アノテーション結果そのものをハードラベル、そこから考えられる真のラベルの可能性の分布をソフトラベルとし、それぞれを用いて二つのネットワークを学習する自己緩和型共同学習を提案した。提案手法は既存の誤ラベルに対処して学習する手法よりも高い性能を示した。

感想

医療という普段なじみのない分野ながら、アノテーション稼働の制約やクラスと実態の剥離からくる課題には共感する部分が多かったです。

画像入力から点数やスコアを付けるようなタスクはよくあるので活用先も広そうに感じました!

オープンセット認識におけるクラス間の類似度に基づく学習クラス選択

齊藤温人, 金崎朝子 (東工大)

内容

学習データに含まれないクラス(未知クラス)が現れるオープンセット認識において、未知クラスの検出精度は学習するクラス(既知クラス)の選択によって変化する。

この研究では、広範な特徴を獲得しているモデルほど未知クラスの検出性能が高いという仮説のもと、既知クラス間の類似度を定義して、その類似度平均と未知クラス検出性能の関係の調査を行った。ランダム選択したクラスでの実験では優位な関係は認められなかったが、極端に類似度平均が小さくなるクラスの組み合わせでは、未知クラスの検出性能が向上することが分かった。

感想

未知クラスへの検出性能に既知クラスの類似度が関係するという点が実験から示されているところが興味深かったです。

実用においては用途次第ですがクラスの選択はそれほど自由に入れ替えるわけにはいかないと思うのでこの傾向をどう活用するか議論の余地がありそうです。展望として言語特徴における類似性にも言及していたので今後の展開も気になります。

大規模言語モデルを用いた日本語視覚言語モデルの評価方法とベースラインモデルの提案

佐々木謙人 (Turing, 筑波大), 井ノ上雄一 (Turing, 慶大), 藤井一喜 (Turing, 東工大), 棚橋耕太郎 (Turing), 山口祐 (Turing, 慶大)

内容

ChatGPTをはじめとした大規模言語モデルを画像エンコーダーと組み合わせることで画像入力に対応した視覚言語モデル(VLM)は、キャプション生成やVQAタスクにおいて高い性能を示している。

しかし、大規模言語モデルの多くは英語圏のデータ中心に学習されているため日本語能力は英語能力ほど高くないと考えられる。また評価用のデータセットも英語データが主体となるためVLMの日本語性能を評価することも難しいという状況である。

この研究では、日本語特有の画像(アニメ、相撲など)への日本語での質問と回答を含むデータセットを作成し、既存の評価データセットを日本語翻訳したものと合わせて用いてVLMの日本語能力の性能評価の指針を提示した。

また日本語LLMを用いて構築したVLMと他の大規模モデルなどを上記手法で評価し、指示チューニングの有効性やさらなる性能向上に大規模な学習が必要であることを示した。

感想

多くの大規模モデルが日本語にも対応はしているため、単なる利用者としてそれらを使っていると日本語性能の低さというのは課題として感じにくいところだったのでハッとさせられました。

日本語VLMの性能評価の指針を示すだけでなく、日本語LLMを用いたVLMの構築方法もソースコード含めて公開しており、日本語VLMの発展を本気で願う想いの強さを感じる研究でした。

最後に

本記事ではMIRU2024の参加報告を通して、企業展示した際の内容を通して我々のチームの取組の紹介、気になった発表の紹介をしました。冒頭の繰り返しになりますが、ドコモってこんな事もやっていたんだというリアクションを貰えれば我々は満足です。

今回紹介した取組以外にもドコモとしてR&D、部署、チームとしても多くのことに取り組んでいます。取り組まれていないことでもいい意味で好き勝手に取り組んでいる人がたくさんいたり、取り組める環境があります。また、様々な専門知識、バックグラウンドを持って新卒やキャリア採用問わず合流された方が多くいらっしゃいます。本記事や本アドベントカレンダー、普段の情報発信を通じて少しでも興味を持っていただけた方はぜひインターンへの参加や新卒、キャリア採用への応募をお願いいたします。